El lado oscuro del silicio: Cómo la tecnología estadounidense alimentó el estado de vigilancia chino

Un análisis revelador del rol de empresas de EE.UU. en la expansión de la represión tecnológica en China

El mayor experimento de control digital del planeta

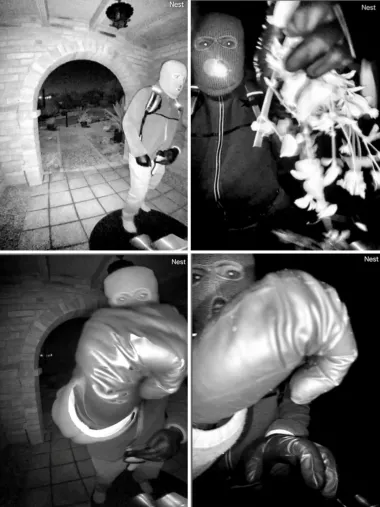

China ha desplegado el aparato de vigilancia digital más vasto del mundo. Desde calles urbanas hasta aldeas rurales remotas, millones de cámaras, sensores biométricos, sistemas de puntuación social e inteligencia artificial se combinan para monitorear y controlar a la población. Pero lo que muchas veces queda oculto en este panorama orwelliano es el rol significativo que han jugado las empresas tecnológicas de Estados Unidos en su desarrollo.

Una investigación periodística reciente ha sacado a la luz que gigantes como IBM, Dell, Microsoft, Intel y Nvidia no solo vendieron tecnología a China, sino que contribuyeron, de forma directa o indirecta, al diseño de las mismas herramientas que ahora perpetúan violaciones a los derechos humanos en ese país.

Desde Silicon Valley hasta Xinjiang

Uno de los ejemplos más alarmantes se ubica al oeste de China, en la región de Xinjiang, donde la población minoritaria uigur ha sido sometida a una de las campañas de vigilancia y represión más extensas del siglo XXI.

Sistemas de "policía predictiva", alimentados con datos de ADN, mensajes de texto, llamadas telefónicas, consumo eléctrico, registros de vuelos y hasta actividad en redes sociales fueron utilizados para detectar, etiquetar y detener a personas consideradas 'sospechosas', muchas veces sin que hubieran cometido delito alguno.

“Era mejor capturar a miles de inocentes que dejar libre a un solo 'terrorista'”. — Nureli Abliz, antiguo ingeniero en Xinjiang.

IBM fue señalada por haber vendido su software i2 a la Oficina de Seguridad Pública en Xinjiang, sistema luego replicado por intermediarios como Landasoft para etiquetar a cientos de miles de uigures. IBM niega haber tenido conocimiento de este uso y afirma haber cortado vínculos con dichos revendedores en 2014, aunque la evidencia sugiere lo contrario.

Las víctimas invisibles del control digital

El caso de Yang Guoliang y su familia pone rostro humano a ese engranaje de control. Vivían una vida sencilla en Jiangsu, hasta que se vieron envueltos en una disputa territorial con las autoridades locales. Al intentar apelar directamente ante el gobierno de Pekín, fueron catalogados como "personas clave" en los sistemas de vigilancia, impidiéndoles salir de su provincia y siendo detenidos preventivamente.

Hoy, Yang Guoliang vive solo, encerrado en su propia casa. Su esposa y su hija menor están en prisión acusadas de “perturbar el orden del Estado”, y su hija mayor se encuentra en Japón, desde donde denuncia la represión estatal.

“Cada movimiento, incluso dentro de mi casa, es monitoreado. Esta vigilancia me hace sentir inseguro constantemente”. — Yang Guoliang

¿Negligencia o complicidad?

Muchas de las compañías involucradas han dicho cumplir con las leyes de exportación de EE.UU. y desconocer el uso final de sus productos. Sin embargo, la evidencia muestra que en varios casos, promocionaron activa y específicamente sus productos como herramientas para el control poblacional.

En 2019, Dell, junto con la firma de vigilancia china Yitu, promocionó portátiles de grado militar con reconocimiento facial de “todas las razas” en su canal oficial de WeChat. NVIDIA publicó en 2022 que empresas como Watrix usaban sus chips para entrenar drones con IA capaces de identificar a las personas por su forma de caminar.

El programa ‘Ojos Afilados’ y el regreso del Gran Hermano

Entre los programas más conocidos desarrollados en China se encuentra “Ojos Afilados” (Sharp Eyes), una iniciativa de vigilancia masiva que conecta cámaras callejeras con redes ciudadanas y el sistema policial en tiempo real. Esta interconectividad ha sido posible gracias a la infraestructura tecnológica proporcionada inicialmente por corporaciones estadounidenses.

El resultado es una nación donde las personas que se organizan políticamente, protestan, practican religiones no autorizadas o simplemente tienen antecedentes de quejas contra el estado, son sujetas a una densa red de vigilancia ubicua y disuasiva.

La trampa de la “tecnología de uso general”

Uno de los mayores problemas legales y éticos radica en cómo se categoriza la tecnología. Muchos productos —desde microprocesadores hasta algoritmos de análisis de video— tienen aplicaciones legítimas, pero también pueden utilizarse con fines represivos. Esta dualidad ha permitido a muchas empresas sortear restricciones:

- Intel colaboró con compañías chinas dedicadas al reconocimiento facial.

- Western Digital y Seagate vendieron discos duros optimizados para IA específicamente a fuerzas policiales.

- Esri y HP aportaron software de mapeo geoespacial que se usan para restringir la movilidad de disidentes según su ubicación.

Incluso después de haber impuesto sanciones tras las denuncias de abusos en Xinjiang, muchas corporaciones mantuvieron contratos con empresas intermediarias o actualizaron equipamiento ya instalado, dejando la puerta abierta a que sus tecnologías continúen funcionando.

Las grietas en la legislación internacional y el dilema moral

Un punto crítico es que las regulaciones internacionales y nacionales no han podido seguir el ritmo del avance tecnológico. La ley estadounidense de exportación, por ejemplo, prohibía desde 1989 la venta de equipos militares a China, pero no abarcaba tecnologías emergentes como IA, minería de ADN, software de predicción de comportamiento ni vigilancia basada en redes neuronales.

Según expertos, el lobby corporativo también ha sido un obstáculo importante. La dependencia mutua entre tecnología y seguridad nacional ha hecho que gobiernos duden en sancionar fuertemente a estas corporaciones, temiendo un retroceso estratégico o económico.

Una advertencia global: de China al mundo

Lo que comenzó como un experimento en autoritarismo digital dentro de China ha sido exportado a más de 80 países, incluidos Irán, Venezuela, Rusia e incluso democracias emergentes en África y América Latina.

Lo más alarmante es que muchos de estos sistemas nacieron o fueron impulsados por compañías que, en el discurso, defienden los derechos humanos y las libertades civiles.

“Por culpa de esta tecnología, no tenemos libertad alguna. Hoy sufrimos nosotros los chinos, pero tarde o temprano los estadounidenses también perderán sus libertades”. — Yang Caiying, en el exilio en Japón.

¿Hacia una distopía inevitable?

La creciente interoperabilidad entre tecnologías comerciales, inteligencia artificial avanzada, biometría e internet de las cosas está permitiendo a gobiernos autoritarios dar el salto desde el clásico totalitarismo a regímenes de control automatizado.

Un informe del Freedom House de 2023 reveló que el 79% de los usuarios de internet viven en países donde las expresiones políticas están sujetas a censura digital, y el 45% están bajo algún tipo de vigilancia masiva.

La responsabilidad que no se puede tercerizar

Estamos ante uno de los casos más claros y documentados de cómo el big tech puede ser cómplice —intencional o no— de políticas de represión estatal. Y aunque las empresas puedan escudarse en los “usos imprevistos” de sus productos o la falta de pruebas directas, la ética tecnológica no puede depender solo de la letra fría del contrato.

La frase “No hacer el mal”, otrora lema de Google, resuena de forma irónica al ver cómo tecnologías hechas en oficinas del Silicon Valley han sido utilizadas para aplastar la dignidad de millones de personas.

Y ahora, ¿quién vigila a los vigilantes?

Esta historia no solo es sobre China, sino sobre la evolución del poder digital sin freno. En un mundo donde las tecnologías proliferan más rápido que las regulaciones, la vigilancia total puede empezar lejos, pero terminar cerca de casa.

El deber recae no solo en legisladores o activistas, sino también en nosotros como usuarios, consumidores, profesionales de la tecnología y ciudadanos del mundo. Porque la próxima vez que un sistema detecte un rostro, lea un correo o “prediga” un comportamiento —podríamos ser nosotros los observados.