¿Quién controla el futuro de la inteligencia artificial? La respuesta podría no ser Silicon Valley

Una nueva coalición filantrópica llamada Humanity AI busca devolverle a las personas el poder sobre la evolución de la inteligencia artificial, con un enfoque centrado en la ética, la equidad y el bienestar humano.

El dilema de la inteligencia artificial: tecnología para pocos o para todos

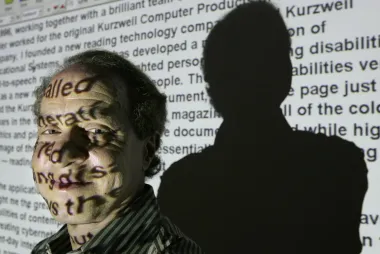

La inteligencia artificial (IA) ha penetrado cada rincón de nuestra vida diaria: desde el diagnóstico médico hasta los algoritmos que deciden qué vemos en las redes sociales. Pero detrás de la aparente neutralidad tecnológica, hay una preocupación cada vez más apremiante: ¿quién decide cómo evoluciona esta tecnología? ¿Está diseñada con fines humanos o alimentada únicamente por intereses corporativos que priorizan las ganancias?

Una iniciativa reciente está intentando redefinir esta narrativa. Humanity AI, una coalición de diez fundaciones prominentes, anunció la creación de un fondo de 500 millones de dólares que será distribuido en los próximos cinco años. Su misión es clara: garantizar que la inteligencia artificial beneficie realmente a la humanidad, no solo a los poderosos del sector privado.

El poder económico detrás de la IA

Durante la última década, el desarrollo de la IA ha sido liderado principalmente por un puñado de gigantes tecnológicos como Google, Microsoft, Meta y OpenAI. Estas empresas han invertido miles de millones de dólares en investigación y desarrollo, lo que ha ampliado su dominio sobre los marcos más utilizados —como ChatGPT o Gemini— y sobre bases de datos de entrenamiento tan grandes que solo ellos pueden mantenerlas.

Según datos de CB Insights, las inversiones globales en IA alcanzaron los 67.000 millones de dólares en 2023, con un 75% de esas inversiones provenientes de tan solo diez empresas. El problema no es la innovación en sí, sino el desequilibrio que genera cuando las decisiones sobre cómo debe funcionar la tecnología se toman en salas de juntas, sin involucrar a comunidades, gobiernos ni ciudadanos.

Humanity AI: una nueva mirada desde la filantropía

Humanity AI apunta a cambiar ese paradigma. Impulsada por fundaciones como MacArthur, Mozilla, Ford, Mellon y Packard, esta coalición pretende promover una IA centrada en las personas. Las organizaciones participantes deberán apoyar al menos una de las siguientes cinco áreas prioritarias:

- Avanzar la democracia

- Fortalecer la educación

- Proteger a los artistas y la creatividad

- Mejorar el trabajo y las condiciones laborales

- Defender la seguridad personal

El mensaje, como señaló Nabiha Syed, directora ejecutiva de la Mozilla Foundation, es contundente: “Podemos elegir participación sobre control. Los sistemas que moldean nuestras vidas deben ser construidos por personas, abiertos por diseño y alimentados por la imaginación”.

IA con propósito: casos donde marca la diferencia

No todo es negativo en el desarrollo de IA. De hecho, ya existen múltiples aplicaciones con un profundo impacto social positivo:

- Medicina: algoritmos de IA ayudan a detectar cáncer de mama con una precisión del 94%, según estudios del MIT.

- Comunicación: tecnologías de clonación de voz permiten que personas con discapacidades del habla se expresen libremente.

- Educación: IA utilizada para la traducción en tiempo real de manuales y textos clave en zonas rurales o en contextos de migración de emergencia.

La clave, sin embargo, es quién controla estas aplicaciones, cómo se financian y bajo qué estándares éticos operan.

Los peligros bajo la superficie

En contraste, la IA también está generando una serie de efectos colaterales preocupantes:

- Desinformación: los deepfakes generados con IA están siendo utilizados para manipular opiniones públicas, crear noticias falsas y difamar a figuras públicas.

- Impacto ambiental: los modelos actuales consumen enormes cantidades de energía. Un estudio de OpenAI estimó que solo el entrenamiento de GPT-3 generó más de 550 toneladas de CO₂.

- Desigualdad: su impacto laboral especialmente entre jóvenes o trabajadores con poca cualificación está generando una creciente inseguridad laboral.

Como declaró Michele L. Jawando de la Omidyar Network: “La tecnología no es nuestro destino, sino una decisión colectiva. El futuro será escrito por personas, no por algoritmos”.

El rol del activismo digital y la cultura

Uno de los objetivos de Humanity AI es también proteger la expresión cultural y artística frente a sistemas automatizados que muchas veces copian sin permiso ni compensación. Artistas han denunciado que sus obras son utilizadas para entrenar modelos generativos sin su consentimiento, erosionando la propiedad intelectual y la originalidad creativa.

La protección de la cultura en una era digital exige marcos legales robustos, prácticas justas de licenciamiento y una IA que no explote sino amplifique la creatividad humana. Un ejemplo es la iniciativa de Mozilla de apoyar herramientas de IA de código abierto diseñadas para y por comunidades creativas.

Más allá del capital: educación y participación

Otra línea clave es la alfabetización en IA. Humanity AI pretende destinar parte de sus recursos a formar a comunidades en la comprensión crítica de los sistemas algorítmicos. Esta alfabetización va más allá del uso técnico: incluye entender cómo se recopilan los datos, cómo puede haber sesgos y cómo exigir transparencia.

Un estudio llevado a cabo por la UNESCO resaltó que solo el 13% de los países del sur global incluyen formación en IA dentro de sus currículos escolares. Reducir esta brecha es vital para evitar una nueva era de colonialismo digital donde unos pocos países decidan cómo deben vivir los demás.

Fundaciones coordinadas: el poder de la acción conjunta

Humanity AI no es una isla. Se suma a otros esfuerzos como el financiado por la Gates Foundation y Ballmer Group, que en julio anunciaron un fondo de 1.000 millones de dólares en 15 años para desarrollar herramientas de IA para defensores públicos, trabajadores sociales y otros profesionales que ayudan a poblaciones vulnerables en EE.UU.

Con este tipo de esfuerzos coordinados, estas fundaciones están posicionando un contrapeso importante y necesario frente al casi monopolio de las tecnológicas privadas.

¿Y ahora qué?: la próxima frontera

La coalición comenzará a otorgar subvenciones este otoño y prevé la creación de un fondo común para 2026, el cual será gestionado por Rockefeller Philanthropy Advisors. El objetivo: generar un ecosistema de tecnología equitativa, diversa y participativa.

No se trata de frenar la innovación, sino de conducirla con responsabilidad. De imaginar una IA no centrada en el control, sino en la colaboración. De que la ética deje de ser un accesorio y se convierta en el esqueleto del diseño tecnológico.

Humanity AI no tiene todas las respuestas, pero nos recuerda una gran verdad: el mañana no está escrito, y la pluma siempre puede volver a nuestras manos.