TikTok y Meta bajo la lupa de la Unión Europea: ¿El inicio del fin de la impunidad digital?

Una investigación en el marco de la Ley de Servicios Digitales descubre prácticas opacas en dos de las plataformas más influyentes del mundo: ¿estamos a las puertas de una nueva era de responsabilidad digital?

¿Qué está pasando exactamente con TikTok y Meta en Europa?

La Unión Europea ha elevado la presión contra dos de las plataformas más populares e influyentes del mundo digital: Meta (matriz de Facebook e Instagram) y TikTok. Tras investigaciones iniciadas este año bajo el marco de la Digital Services Act (DSA), la Comisión Europea ha revelado que ambas empresas incumplieron obligaciones clave en materia de transparencia, lo cual podría acarrear consecuencias financieras colosales: multas de hasta el 6% de sus ingresos anuales.

¿Qué es la Ley de Servicios Digitales (DSA)?

La DSA, en vigor desde 2023, es una de las legislaciones más ambiciosas del mundo destinadas a regular los servicios digitales en la UE. Su objetivo principal es proteger a los ciudadanos en el entorno digital obligando a las grandes plataformas a ser más transparentes, seguras y responsables.

Entre sus exigencias clave destacan:

- Facilitar mecanismos claros para reportar contenido ilegal o dañino, como discursos de odio, apología del terrorismo o abuso infantil.

- Evitar los "patrones oscuros", o sea, diseños manipulativos de la interfaz que buscan dirigir al usuario sin que este lo note conscientemente.

- Permitir a los investigadores acceso a datos claves, para garantizar el escrutinio público sobre los posibles efectos que estas plataformas tienen sobre la sociedad, particularmente la salud mental y física.

- Prohibir la publicidad dirigida a menores.

¿Qué halló la Comisión Europea?

En el caso de Meta, la investigación arrojó varias violaciones:

- Dificultades para reportar contenido ilegal en Facebook e Instagram, con procesos considerados poco intuitivos o disuasorios.

- Desacreditación del mecanismo de apelaciones frente a la moderación del contenido por parte del usuario.

- Uso de "dark patterns" en el diseño de interfaz que confunden a los usuarios y dificultan su control sobre la experiencia digital.

En cuanto a TikTok, la Comisión detectó:

- Falta de cooperación suficiente con investigadores, al no ofrecer las herramientas adecuadas para recolectar y estudiar datos de forma efectiva.

- Dificultades similares a las de Meta para que los usuarios denuncien contenido dañino.

¿Qué han dicho las empresas?

Meta, en voz de su portavoz Ben Walters, manifestó su oposición a los hallazgos: “Hemos introducido cambios en nuestras opciones de denuncia de contenido, el proceso de apelación y las herramientas de acceso a datos desde la entrada en vigor de la DSA y creemos que cumplen con la ley”.

Por otro lado, TikTok, mediante Paolo Ganino, se pronunció en términos más prudentes, expresando su intención de revisar el informe. No obstante, criticó que algunas de las exigencias de transparencia de la DSA entran en conflicto con el Reglamento General de Protección de Datos (GDPR) de la propia UE, generando un potencial dilema legal.

¿Por qué este momento es crítico para el futuro digital europeo?

Este no es simplemente un enfrentamiento entre burocracia regional y corporaciones tecnológicas: se trata de la redefinición de los derechos ciudadanos en el entorno digital. Tras años de denuncias por prácticas abusivas, algoritmos opacos y abuso de datos, la UE quiere transformar Internet en un espacio que respete la libertad, la seguridad y el acceso equitativo a la información.

En palabras de Henna Virkunnen, vicepresidenta ejecutiva de la UE para soberanía tecnológica: “Nuestras democracias dependen de la confianza. Las plataformas deben empoderar a los usuarios, respetar sus derechos y abrir sus sistemas al escrutinio. La DSA convierte eso en una obligación, no en una opción”.

¿Y si no cumplen?

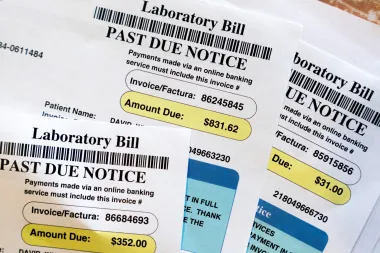

El incumplimiento prolongado de estas reglas puede acarrear sanciones económicas de hasta el 6% de la facturación anual global de las plataformas. Para tener referencia:

- Meta tuvo ingresos de más de $116 mil millones en 2023. Una multa del 6% podría equivaler a casi $7 mil millones de dólares.

- TikTok, propiedad de ByteDance, no publica cifras detalladas, pero se estima que sus ingresos globales superaron los $20 mil millones en 2023.

Estas cifras transforman esta investigación en una amenaza real y palpable para la rentabilidad de los gigantes digitales.

Un contexto más amplio: el rol político de las plataformas

Desde el escándalo de Cambridge Analytica de 2018 hasta las campañas de desinformación que influyeron en elecciones clave, se ha hecho evidente que las redes sociales no son actores neutrales. Son herramientas políticas, sociales y culturales que modifican percepciones, amplifican discursos y afectan directamente a las democracias.

El Parlamento Europeo ha solicitado además mayor control sobre contenido que promueva odio, racismo, teorías conspirativas antivacunas y terrorismo. Estas plataformas –al priorizar el contenido que genera más interacción, sin importar su veracidad o consecuencias– ponen en riesgo la cohesión social.

Más que multas: ¿un cambio estructural en curso?

La gran pregunta ahora es si estas medidas servirán más que como castigo. Porque más allá de las sanciones económicas, lo que se busca es forzar cambios estructurales y profundos en la forma en que las plataformas diseñan, moderan y monetizan sus servicios. Algunas posibles transformaciones podrían incluir:

- Interfaces más transparentes, con botones de denuncia visibles y accesibles.

- Métodos más claros para explicar decisiones de moderación y permitir apelaciones reales.

- Creación de comités independientes de vigilancia de contenido.

- Mayor integración de sistemas éticos en el diseño algorítmico.

Tensiones entre transparencia y privacidad

Uno de los focos más delicados del debate es la tensión entre transparencia de datos y protección de la privacidad. Mientras la DSA exige a las plataformas compartir información para su análisis por parte de investigadores, el Reglamento General de Protección de Datos (GDPR) impone límites estrictos al uso de datos personales.

Esto crea un campo minado legal: ¿cómo ofrecer acceso transparente sin violar la privacidad? ¿Debería Europa actualizar su legislación para armonizar ambos marcos? TikTok ha pedido urgentemente "claridad regulatoria".

¿Y el resto del mundo?

Europa se posiciona como referente global en regulación digital, marcando un camino que tal vez otras regiones, como América Latina o Asia, puedan seguir. La Ley de Servicios Digitales puede convertirse en el modelo a imitar para un nuevo contrato social de la era digital.

Sin embargo, aún estamos en las primeras etapas. Si Meta y TikTok logran manipular o dilatar el proceso, podrían normalizar una cultura de “cumplimiento aparente” sin verdaderos cambios.

Una batalla más grande de lo que parece

Lo que está en juego no es solo la cantidad de dinero que pagarán empresas multimillonarias, sino la forma en que se configura nuestra relación cotidiana con la tecnología. ¿Tenemos derecho a entender cómo funcionan los algoritmos que determinan lo que vemos? ¿Puede un menor navegar sin ser manipulado por anuncios?

La lucha por un Internet ético, seguro y democrático ha comenzado en serio. Y aunque Meta y TikTok estén en el banquillo hoy, mañana podrán estarlo otras: desde X (antes Twitter) hasta Google y YouTube.

¿Es este el principio del fin de la impunidad digital? Ojalá sea el inicio de una nueva era donde los derechos de las personas valgan más que la monetización del tiempo de pantalla.